I deepfake diventano sempre più realistici: Facebook risponde al problema con un’AI che non solo li identifica, ma ne traccia anche le fonte.

I deepfake più sofisticati possono farci dubitare della nostra stessa percezione: video ed immagini false, generate tramite una tecnica di apprendimento automatico, possono influenzare il pubblico dei social media, compromettere la reputazione di qualcuno con la diffusione di informazioni false, e facilitare la criminalità informatica. Per contrastare i pericoli di questo fenomeno, Facebook ha deciso di rispondere all’intelligenza artificiale con le sue stesse armi. In collaborazione con l’Università statale del Michigan (MSU), ha presentato un nuovo metodo di identificazione dei deepfake tramite AI che, con un processo di ingegneria inversa, risale alla fonte originale dell’immagine senza dati aggiuntivi.

I modelli attualmente disponibili funzionano secondo il principio del discernimento delle immagini vere da quelle false (rilevamento), oppure dell’identificazione di immagini generate tramite modelli analizzati durante l’addestramento (attribuzione dell’immagine via classificazione “close-set”, ravvicinata), ma nessuno è in grado di compiere il passo successivo ed estendere l’analisi delle immagini oltre i limiti imposti dalle librerie di modelli riconosciuti durante il training dell’AI, e scongiurare la diffusione di deepfake generati da fonti sconosciute.

LEGGI ANCHE >>> Gmail centro di comando: progettazione e rivoluzione Google

Come Facebook riconosce e traccia le immagini deepfake tramite AI

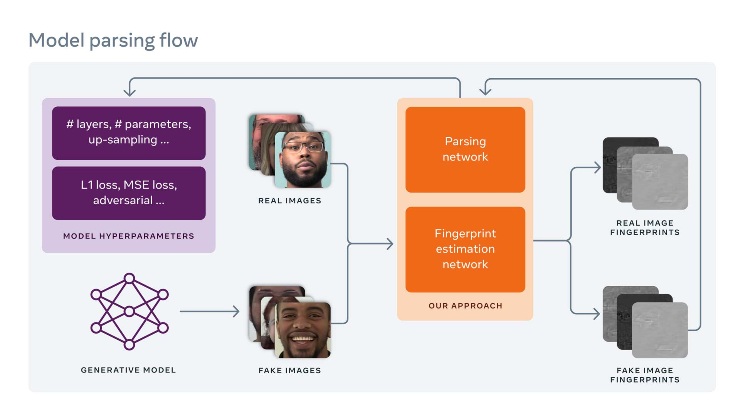

Il metodo di ingegneria inversa mira a rivelare i pattern unici utilizzati dal modello AI per la creazione di un’unica immagine deepfake. Il rilevamento viene effettuato tramite Fingerprint Estimation Network (FEN), una tecnologia in grado di distinguere anche le impronte più lievi dei modelli impressi sull’immagine dal dispositivo con cui è stata generata: ogni modello generativo ha le proprie particolarità identificative. Questa attribuzione dell’immagine è il primo passo, seguito dall’analisi delle proprietà del modello utilizzato: generalizzando il processo di attribuzione dell’immagine da riconoscimento “close-set” a “open-set“, sarà possibile ottenere più informazioni sul modello stesso, oltre al fatto che non è mai stato riconosciuto precedentemente.

Tracciando le somiglianze tra più pattern in un catalogo ampio di deepfake, si potrà risalire anche ad un’intera serie di immagini generate dalla stessa fonte: è proprio questa funzionalità che potrebbe costituire un’importante svolta per sventare campagne di disinformazione ed attacchi coordinati sui social media.

LEGGI ANCHE >>> Truffa ed estorsione su Facebook e WhatsApp, arrestati due soggetti